AGI là những hệ thống có khả năng tự học mọi tri thức, có trí thông minh giống con người và có thể thực hiện các nhiệm vụ mà nó không nhất thiết phải được đào tạo hoặc phát triển.

Tháng 6/1956, một nhóm nhà khoa học và toán học từ khắp nước Mỹ tụ họp tại Đại học Dartmouth. Họ tranh luận về một chủ đề mới đến mức khi đó còn chưa có tên gọi. "Họ không thống nhất được việc nó thực sự là gì, thực hiện nó thế nào, hay gọi nó ra sao", Grace Solomonoff, vợ của một trong những nhà khoa học đã kể lại trên Smithsonianmag. Những gì các chuyên gia đang bàn là làm sao tạo ra được một "cỗ máy biết nghĩ và học tập".

Các chuyên gia, nhà khoa học trong Hội thảo Dartmouth

Cuộc tranh luận tại Hội thảo Dartmouth là một trong những khởi đầu của công cuộc tìm kiếm kéo dài hàng thập kỷ về trí tuệ nhân tạo. Trước đó, vào năm 1948, Alan Turing, cha đẻ ngành khoa học máy tính, cũng dự đoán về sự hình thành của AI toàn năng, có thể tư duy, học hỏi tương tự con người.

Trong hàng chục năm qua, con người đã và đang phát triển các giải pháp khác nhau về trí tuệ nhân tạo chuyên để thực hiện những nhiệm vụ riêng biệt. Ví dụ, Google đưa AI vào chẩn đoán bệnh tim. Người dùng sử dụng ChatGPT để làm văn, viết thơ, hay thậm chí là hỗ trợ các giải pháp về tâm lý học con người như một người bạn/người tư vấn thực thụ.

Tuy nhiên, thứ mà các nhà khoa học hướng tới là trí tuệ nhân tạo tổng quát AGI (Artificial General Intelligence) - những cỗ máy có khả năng tư duy như loài người. Chính khái niệm này đã được nhà vật lý người Mỹ Mark Gubrud đề cập trong các thảo luận về chủ đề tự động hóa từ năm 1997.

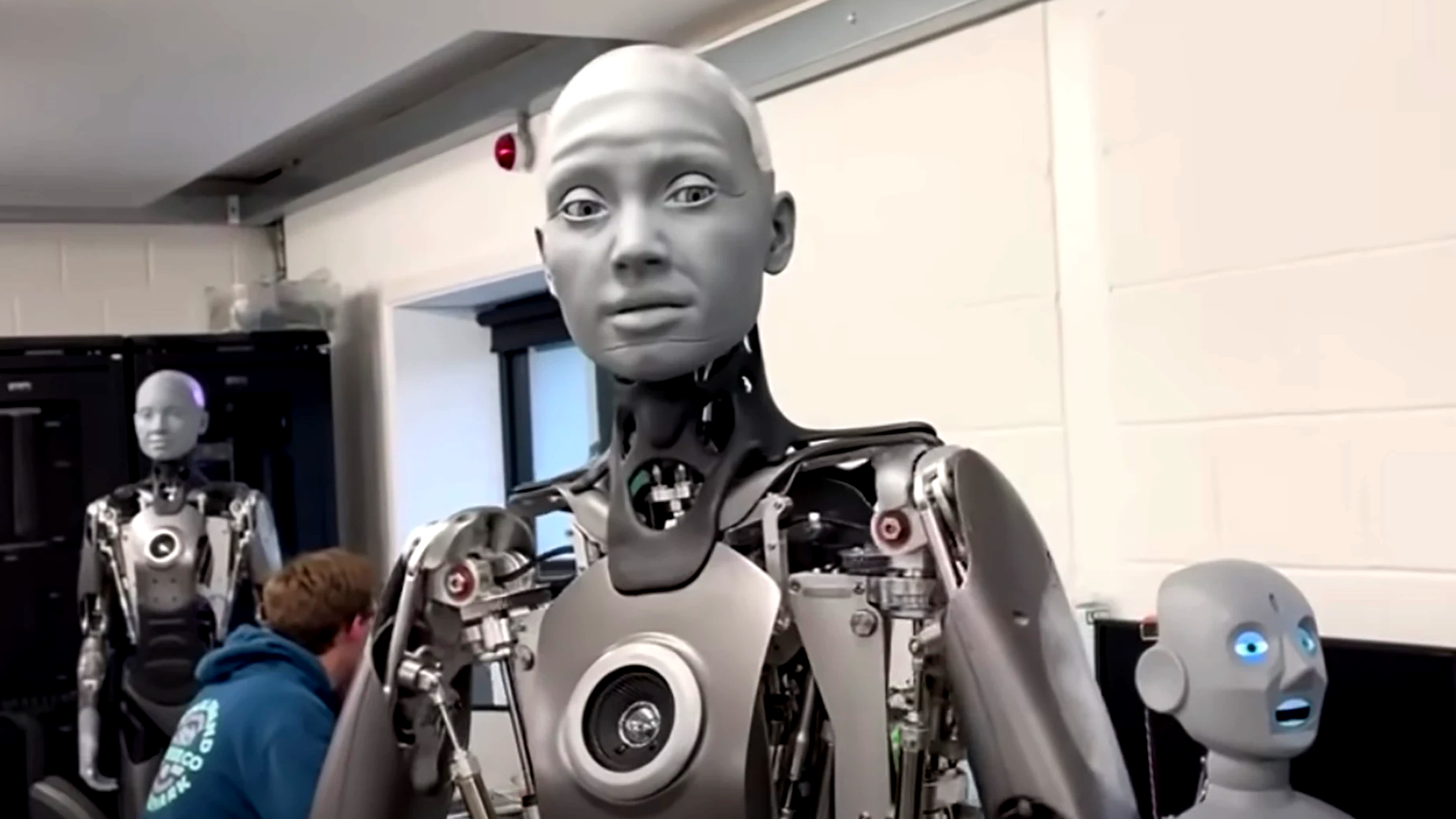

Robot trí tuệ nhân tạo hình người Ameca của công ty Engineered Arts.

Hiện nay, vì AGI chưa xuất hiện nên được các nguồn định nghĩa khác nhau, nhưng có thể hiểu chung là một dạng "siêu trí tuệ", thông thạo đa dạng lĩnh vực, học tập liên tục không ngừng nghỉ và làm được mọi việc, thậm chí tương lai có thể vượt xa khả năng tư duy của con người.

Vậy AGI đang được phát triển đến đâu?

Theo Geoffrey Hinton, giáo sư đoạt giải Turing - giải thưởng cao nhất về khoa học máy tính, nói với CBS News vào tháng 3 rằng: “con người phải mất từ 20 tới 50 nữa mới có thể đạt được AGI, tuy nhiên hiện tại mọi thứ thay đổi quá nhanh chóng và vấn đề là chúng ta cần tìm cách để kiểm soát chúng.

Giáo sư Geoffrey Hinton trong cuộc phỏng vấn với CBS News

Theo chuyên gia về AI, Ian Hogarth của chính phủ Anh, AGI biết sáng tạo, phát triển một cách tự chủ và ý thức được sự tồn tại của bản thân. "AGI hiểu ngữ cảnh giao tiếp mà không cần cung cấp thêm gợi ý. Chúng sẽ trở thành một thế lực nằm ngoài tầm kiểm soát và hiểu biết của chúng ta", ông nói.

Ngày 16/11 tại Diễn đàn Hợp tác Kinh tế châu Á - Thái Bình Dương (APEC) ở San Francisco, Sam Altman, CEO OpenAI phát biểu: "Trong bốn lần tạo nên lịch sử tại OpenAI, lần gần nhất chỉ mới cách đây vài tuần. Tôi đã có mặt trong phòng. Chúng tôi gần như đã đẩy lùi bức màn tối phía trước và mở ra biên giới khám phá mới".

Giám đốc của công ty OpenAI tại hội nghị APEC

Trên mạng xã hội X, tỷ phú Elon Musk cũng đặt nghi vấn về công ty OpenAI có thể đang phát triển "điều gì đó đáng sợ". "Thế giới cần được biết nếu OpenAI sở hữu thứ gì đó gây nguy hiểm cho nhân loại", ông nói ngày 20/11.

Tỷ phú Elon Musk trong bài phát biểu ngày 20/11

Có thể tổng kết lại rằng mặc dù siêu trí tuệ nhân tạo AGI đang được con người phát triển ở nhiều hình thức khác nhau và hỗ trợ rất nhiều về Công nghệ, giải pháp ứng dụng vào các công việc đa dạng trong xã hội. Tuy nhiên xét về khía cạnh khác thì AGI cũng đang được các chuyên gia đánh giá là mối đe dọa tới nhân loại nếu chúng ta không kiểm soát và định hướng chính xác sự tiến hóa của một thứ “trí tuệ có thể vượt xa con người” này.